Você Usa IA, Mas Não Fala a Língua Dela

Existem três alicerces fundamentais: geometria, probabilidade e modos de falha. Entender esses três pilares não é um exercício acadêmico. É o que diferencia um usuário de um operador consciente.

ESCRITA CRIATIVA COM IA

Raniere Menezes

3/10/20263 min read

Você Usa IA, Mas Não Fala a Língua Dela

Existe uma diferença entre operar uma ferramenta e compreendê-la. E essa diferença, no caso da inteligência artificial, separa quem sobrevive da tecnologia de quem a domina.

Pense no piloto e no passageiro. Ambos chegam ao mesmo destino. Mas apenas um deles sabe o que fazer quando a turbulência começa.

A maioria das pessoas que usa IA hoje é passageira. Digitam prompts, recebem respostas, ficam impressionadas ou frustradas — sem nunca entender por que o sistema se comporta de determinada forma. Isso não é culpa delas. Ninguém explicou que por baixo de toda aquela eloquência gerada automaticamente existem três alicerces fundamentais: geometria, probabilidade e modos de falha.

Entender esses três pilares não é um exercício acadêmico. É o que diferencia um usuário de um operador consciente.

Pilar 1: O Mapa Invisível das Palavras

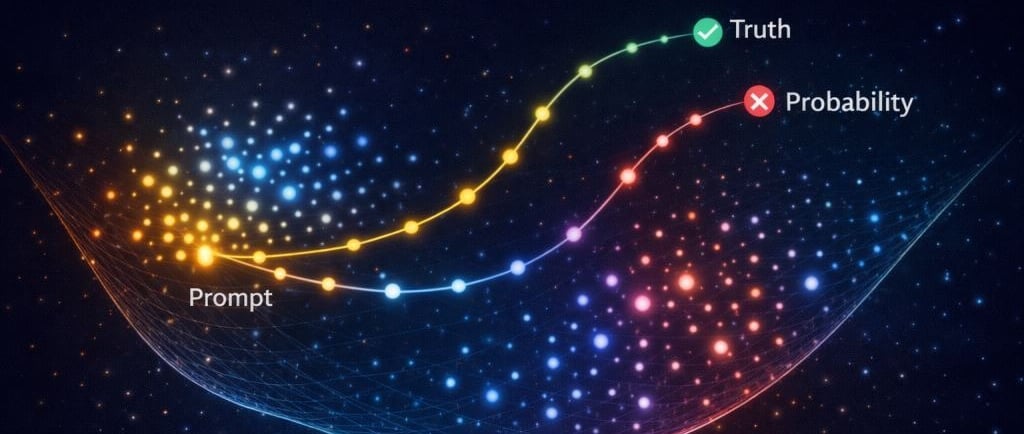

Quando você digita "amor" em um modelo de linguagem, o sistema não consulta um dicionário. Ele projeta a palavra em um espaço matemático com centenas — às vezes milhares — de dimensões. Cada palavra, cada frase, cada conceito existe como um ponto nesse espaço gigantesco. E a proximidade entre esses pontos é o que o modelo interpreta como significado.

Isso tem consequências práticas fascinantes. "Rei" e "Rainha" estão próximos nesse espaço. "Paris" e "França" também. Subtraia o vetor de "Homem" de "Rei" e adicione "Mulher" — e você se aproxima geometricamente de "Rainha". A IA não entende relacionamentos humanos; ela navega por coordenadas.

Essa é a geometria do significado: palavras como coordenadas em um mapa multidimensional que nenhum ser humano consegue visualizar diretamente, mas que o modelo percorre com fluência.

Por que isso importa para você? Porque significa que o modelo responde à proximidade semântica do seu prompt, não à sua intenção real. Quanto mais preciso e contextualizado for o que você escreve, mais próximo você está do "bairro certo" nesse mapa. Prompts vagos chegam em bairros errados.

Pilar 2: A Máquina de Previsão (Não de Verdade)

Aqui mora o mal-entendido mais perigoso sobre IA.

Modelos de linguagem não sabem de nada. Eles preveem. A cada palavra gerada, o sistema calcula: "dado tudo o que veio antes, qual é a próxima palavra mais provável?" É um processo estatístico— mas continua sendo estatística.

Não existe um banco de dados de fatos verdadeiros sendo consultado. Não existe um "cérebro" ponderando a veracidade de cada afirmação. Existe um motor probabilístico bem treinado que produz textos que soam como verdade porque foi alimentado com enormes quantidades de textos verdadeiros.

Isso muda tudo sobre como você deve interpretar uma resposta.

Quando o modelo te diz que uma lei existe, que um evento histórico aconteceu de certa forma, ou que um dado científico está estabelecido — ele está te dizendo a resposta mais provável, não necessariamente a mais correta. A fluência não é prova de acurácia. A confiança no tom da resposta não é evidência de certeza no conteúdo.

Usuários que entendem isso usam a IA como um colaborador que precisa ser verificado, não como uma enciclopédia que pode ser citada.

Pilar 3: A Anatomia do Erro

Alucinações. Vieses. Falhas em raciocínios que uma criança de 10 anos resolveria.

Esses não são bugs que serão corrigidos em uma próxima atualização. São consequências estruturais de como esses sistemas são construídos.

Um modelo que aprendeu padrões estatísticos de texto vai, em algum momento, completar um padrão com informação plausível mas inventada — porque é isso que o padrão "pede".

Um modelo treinado em dados com representações desiguais vai reproduzir essas desigualdades nas respostas. Um modelo que processa linguagem probabilisticamente vai tropeçar em problemas que exigem raciocínio lógico passo a passo, porque esse não é o seu modo nativo de operação.

Conhecer a anatomia do erro transforma você em um usuário crítico. Você passa a reconhecer os sinais: quando o modelo está extrapolando demais, quando está sendo excessivamente confiante em território incerto, quando está otimizando para parecer útil em vez de ser útil.

A Alfabetização Real da Era da IA

Saber usar o ChatGPT não é mais diferencial. Todo mundo sabe apertar o botão.

O diferencial está em entender o que acontece quando você aperta. Está em saber que você está navegando um espaço geométrico de significados, interagindo com um motor probabilístico, e recebendo outputs que têm padrões de falha previsíveis.

Essa compreensão não vai transformar você em engenheiro de machine learning. Mas vai transformar sua relação com a ferramenta.

Da próxima vez que a IA te responder algo com aquela voz segura e fluente — você vai saber exatamente qual pergunta fazer em seguida.

E essa é a diferença entre usar IA e pensar com ela.

Contato

Envie suas dúvidas ou sugestões

ranzemis@gmail.com

© Raniere Menezes